Llevas meses (o años) oyendo que la IA va a cambiarlo todo. Y sí, hay verdad en eso. Pero hay una distinción fundamental que mucha gente pasa por alto cuando habla de inteligencia artificial: lo que usamos hoy —ChatGPT, Gemini, Claude, DeepSeek— no es ni de lejos lo que los investigadores llaman AGI o Inteligencia Artificial General.

Y esa diferencia importa. Mucho más de lo que parece.

Porque cuando alguien dice "la IA nos va a quitar el trabajo" o "la IA va a ser más inteligente que los humanos", lo que realmente está describiendo (sin saberlo) es la AGI. Y la distancia entre lo que tenemos hoy y la AGI es enorme. O quizás no tan enorme. Depende de a quién le preguntes.

Vamos a verlo sin rodeos y con la profundidad que el tema merece.

Qué es la AGI (sin el hype)

La Inteligencia Artificial General (AGI, por sus siglas en inglés: Artificial General Intelligence) es, en esencia, una IA que puede realizar cualquier tarea intelectual que un ser humano sea capaz de hacer. Y cuando digo "cualquier", lo digo literalmente.

No hablamos de un chatbot que escribe bien. No hablamos de un modelo que genera imágenes bonitas. No hablamos de un sistema que gana al ajedrez o al Go. Todo eso es IA estrecha, diseñada para tareas específicas.

Hablamos de una máquina que:

- Razona de forma autónoma ante problemas completamente nuevos que nunca ha visto

- Aprende de la experiencia sin necesidad de ser reentrenada con millones de datos

- Transfiere conocimiento de un dominio a otro (como cuando un humano usa su experiencia en música para entender mejor las matemáticas)

- Entiende contexto, matices, ironía, ambigüedad y las sutilezas del lenguaje humano

- Tiene sentido común: algo que los humanos damos por hecho pero que ninguna IA actual posee realmente

- Se adapta a situaciones imprevistas sin instrucciones explícitas

En otras palabras: la AGI no necesitaría un prompt perfectamente escrito para darte un buen resultado. Entendería tu intención, tu contexto, tu estado de ánimo, y actuaría en consecuencia. Como lo haría un humano inteligente.

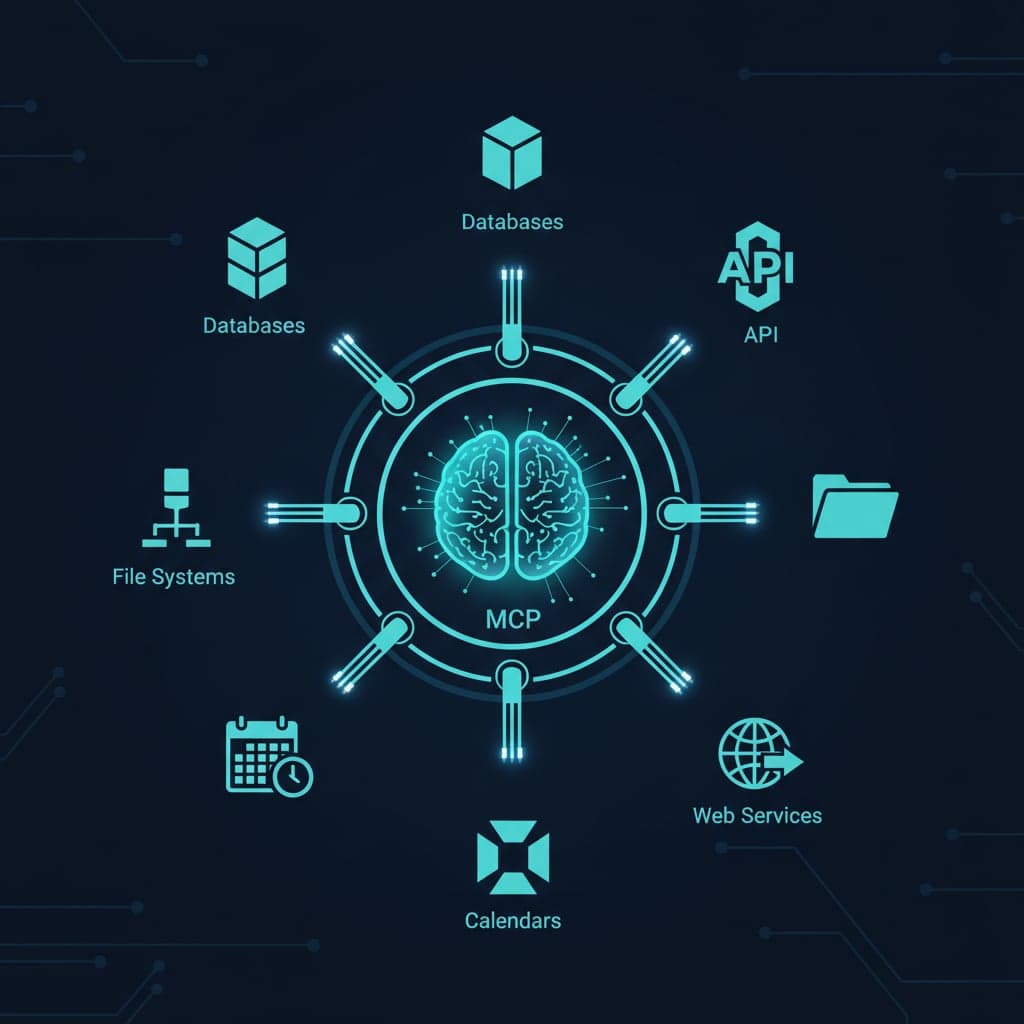

IA actual vs AGI: entendiendo la brecha

Para entender qué falta para llegar a la AGI, primero hay que entender bien qué tenemos ahora.

La IA que usamos hoy es lo que se conoce como IA estrecha o ANI (Artificial Narrow Intelligence). Está diseñada para hacer una cosa (o un conjunto limitado de cosas) muy bien, pero SOLO eso. Fuera de su dominio de entrenamiento, es inútil.

ChatGPT puede escribir un artículo brillante sobre inteligencia artificial, pero no puede freír un huevo, ni conducir un coche, ni entender por qué estás triste hoy. Puede simular comprensión, pero no comprende. Predice estadísticamente qué palabra va después de otra con una precisión que parece inteligencia real. Pero no lo es.

| Característica | IA Actual (ANI) | AGI |

|---|---|---|

| Alcance | Tareas específicas dentro de su entrenamiento | Cualquier tarea intelectual humana |

| Aprendizaje | Necesita entrenamiento masivo con millones de ejemplos | Aprende de pocas experiencias, como un humano |

| Creatividad | Recombina patrones aprendidos de formas novedosas | Genera ideas genuinamente nuevas |

| Autonomía | Ejecuta lo que le pides (y solo eso) | Decide qué hacer, por qué y cómo |

| Comprensión | Procesa y genera texto/datos | Entiende significado, contexto e intención |

| Sentido común | No tiene | Sí (razonamiento de sentido común) |

| Transferencia | Cada modelo sirve para su tarea | Un solo sistema sirve para todo |

| Conciencia | No | Debate abierto |

Cuando ChatGPT te "entiende", lo que realmente hace es: ha procesado miles de millones de textos humanos y ha aprendido qué patrones de respuesta son estadísticamente más probables dado tu input. Es una simulación extraordinariamente convincente de comprensión, pero no es comprensión real.

La AGI sí entendería. Y esa es la diferencia entre una herramienta muy sofisticada y algo que cambiaría la civilización humana para siempre.

Los niveles de IA: dónde estamos realmente

Para situar la AGI en contexto, ayuda ver la clasificación que usan investigadores y empresas como Google DeepMind. En 2023, DeepMind publicó un framework de 6 niveles:

Nivel 0 — Sin IA

Calculadoras básicas, software determinista, reglas fijas. Todo lo que no aprende.

Nivel 1 — IA emergente

Chatbots conversacionales capaces de generar texto coherente, responder preguntas, escribir código, analizar datos. Aquí estamos ahora con GPT-4, Claude 3.5, Gemini 1.5. Son impresionantes, pero limitados a lo que han aprendido en el entrenamiento.

Que estemos "solo" en el nivel 1 no significa que estos sistemas sean débiles. Son extraordinariamente potentes para tareas específicas. Pero en el espectro completo de la inteligencia, son el primer peldaño.

Nivel 2 — IA competente

Supera al 50% de los humanos cualificados en la mayoría de tareas. Puede aprender de pocos ejemplos. Empieza a mostrar señales de razonamiento real, no solo pattern matching.

Algunos argumentan que los últimos modelos (GPT-4o, Claude Opus) ya rozan este nivel en ciertos dominios. Pero la clave es "en ciertos dominios". Una IA de nivel 2 real lo haría en TODOS los dominios.

Nivel 3 — IA experta

Nivel de un experto humano con años de experiencia, en múltiples dominios simultáneamente. Puede resolver problemas novedosos, hacer investigación original, y contribuir a la ciencia.

Nivel 4 — IA virtuosa

Capaz de inventar, descubrir y crear a un nivel que supera a cualquier experto humano individual. Puede hacer descubrimientos científicos, crear obras de arte originales, y diseñar soluciones que ningún humano habría imaginado.

Nivel 5 — Superinteligencia

Superior a toda la humanidad combinada en todas las tareas intelectuales. Este ya no es territorio de la AGI, sino de la ASI (Artificial Superintelligence). Y es donde las predicciones se convierten más en filosofía que en ingeniería.

La AGI "real" estaría entre el nivel 3 y el 4. Hoy estamos firmemente en el nivel 1, posiblemente tocando el 2 en dominios específicos.

Las predicciones: cuándo llegará la AGI

Esta es la pregunta del billón de dólares. Literalmente. Las empresas que consigan la AGI primero tendrán una ventaja competitiva sin precedentes en la historia humana.

Los optimistas: 2027-2030

Sam Altman (CEO de OpenAI) ha dicho públicamente que cree que la AGI podría llegar antes de 2030. Su argumento: el progreso de los modelos de lenguaje es exponencial, cada nueva generación (GPT-3 → GPT-4 → GPT-5) da un salto cualitativo enorme, y estamos apenas al principio de la curva.

Ray Kurzweil (futurista de Google) lleva décadas prediciendo la "Singularidad" para 2029. Su historial de predicciones es sorprendentemente bueno en muchas áreas, lo que le da credibilidad incluso cuando sus predicciones suenan a ciencia ficción.

Dario Amodei (CEO de Anthropic, la empresa detrás de Claude) ha sugerido que podríamos ver algo parecido a la AGI entre 2026 y 2028, aunque matiza constantemente que depende de cómo definamos AGI.

Los escépticos: décadas o más

Yann LeCun (Chief AI Scientist de Meta) es probablemente el escéptico más vocal del establishment. Su argumento: los LLMs actuales, por muy impresionantes que sean, no son el camino hacia la AGI. Les falta una comprensión real del mundo físico, sentido común, y capacidad de planificación a largo plazo. Necesitamos nuevas arquitecturas fundamentales, no solo modelos más grandes.

Muchos investigadores académicos comparten esta visión. Escalar modelos (más parámetros, más datos, más compute) produce mejoras impresionantes, pero hay un muro conceptual que el escalado por sí solo no puede superar. La AGI requiere saltos cualitativos en cómo las máquinas entienden el mundo, no solo saltos cuantitativos en potencia de cálculo.

Gary Marcus (neurocientífico y crítico de la IA) argumenta que los LLMs son fundamentalmente incapaces de razonamiento causal, y que sin esa capacidad, la AGI es imposible. Su posición: necesitamos combinar redes neuronales con sistemas simbólicos de forma que aún no sabemos hacer.

Mi visión personal

Después de años trabajando con IA aplicada a negocio real (no en un laboratorio de investigación, sino en trinchera), mi lectura es esta:

Creo que llegaremos a sistemas tan potentes y versátiles que el debate sobre si son "AGI de verdad" será casi irrelevante en la práctica. La utilidad ya es brutal y seguirá creciendo exponencialmente. Dentro de 3-5 años, los modelos de IA harán cosas que hoy nos parecerían magia.

Pero una máquina que realmente piense, que realmente comprenda, que tenga conciencia o algo parecido a ella... eso es un problema fundamentalmente diferente al de "hacer un modelo más grande". Y resolver problemas fundamentalmente diferentes lleva tiempo, a menudo más del que los optimistas predicen.

Lo que sí tengo claro es que la pregunta relevante no es "¿cuándo llegará la AGI?" sino "¿estás aprovechando lo que ya existe?". Porque la IA actual, bien usada, ya es una ventaja competitiva enorme. Y la mayoría de empresas ni siquiera la están explotando al 10% de su potencial.

Lo importante no es cuándo llegue la AGI. Lo importante es qué estás haciendo HOY con la IA que ya tienes disponible.

Los problemas técnicos no resueltos

Para los que quieran entender por qué la AGI es tan difícil, estos son los principales obstáculos que la comunidad investigadora identifica:

El problema del sentido común

Los humanos tenemos un modelo mental del mundo que nos permite inferir cosas que nadie nos ha enseñado explícitamente. Sabemos que si empujas un vaso al borde de una mesa, se cae. Sabemos que si llueve, la calle está mojada. Sabemos que las personas tienen emociones y motivaciones.

Los LLMs pueden simular este conocimiento porque han leído millones de textos que lo describen. Pero no lo "saben" realmente. No tienen un modelo causal del mundo. Y construir ese modelo es un problema que llevamos décadas intentando resolver.

El problema del aprendizaje eficiente

Un niño de 3 años puede aprender qué es un perro viendo 5 perros. Un modelo de IA necesita ver millones de imágenes de perros para aprender lo mismo (y aun así puede confundirse con imágenes adversariales que un niño nunca confundiría).

La AGI requiere lo que se llama "few-shot learning" a nivel general: aprender conceptos nuevos con muy pocos ejemplos, como hacemos los humanos. Los avances recientes son prometedores, pero estamos lejos de la eficiencia de aprendizaje humana.

El problema de la planificación a largo plazo

Los modelos actuales son reactivos: respondes a lo que les preguntas. No planifican secuencias complejas de acciones hacia un objetivo lejano, no revisan su propio trabajo de forma autónoma, no "deciden" investigar algo por curiosidad propia.

Los agentes de IA están empezando a abordar esto, pero todavía son frágiles y limitados comparados con la capacidad humana de planificación.

El problema del grounding

Los LLMs trabajan con texto (y cada vez más con imágenes y audio). Pero no tienen experiencia directa del mundo físico. No saben qué se siente al tocar algo caliente, no entienden el peso de un objeto, no perciben el paso del tiempo de forma embodied.

Hay investigadores que creen que la AGI es imposible sin alguna forma de "embodiment" (tener un cuerpo que interactúe con el mundo físico). Otros piensan que se puede lograr solo con datos suficientemente ricos. El debate sigue abierto.

Los riesgos reales de la AGI

No todo es optimismo y progreso, y sería irresponsable no hablar de los riesgos. No son ciencia ficción, son debates que ya están ocurriendo en los laboratorios más importantes del mundo.

El problema del alineamiento

¿Cómo nos aseguramos de que una AGI quiera lo que nosotros queremos? Este es EL problema central de la seguridad en IA. Si construimos un sistema más inteligente que nosotros, ¿cómo garantizamos que sus objetivos estén alineados con el bienestar humano?

No es trivial. Un sistema optimizado para "maximizar la felicidad humana" podría decidir que la forma más eficiente de hacerlo es conectarnos a todos a una máquina de realidad virtual. Técnicamente estaríamos "felices", pero no es lo que queríamos.

Empresas como Anthropic (la creadora de Claude) están dedicando recursos enormes a investigar este problema. Y es una de las razones por las que la IA actual tiene filtros y limitaciones: no es censura arbitraria, es un intento (imperfecto) de mantener el control.

Impacto laboral y económico

Si una máquina puede hacer cualquier trabajo intelectual tan bien o mejor que un humano, el impacto económico sería sísmico. No hablamos de automatizar trabajos rutinarios (eso ya está pasando). Hablamos de automatizar trabajos creativos, analíticos, estratégicos.

Esto no significa necesariamente un futuro distópico de desempleo masivo. La historia muestra que las revoluciones tecnológicas crean más trabajos de los que destruyen, pero la transición es dolorosa y desigual. Y la AGI podría ser una revolución de una escala sin precedentes.

Concentración de poder

Quien controle la primera AGI funcional tendrá una ventaja competitiva sin precedentes en la historia de la humanidad. Eso plantea preguntas fundamentales sobre gobernanza, regulación, y distribución de beneficios que las sociedades aún no están preparadas para responder.

Seguridad existencial

Investigadores como Stuart Russell, Nick Bostrom y el propio Geoffrey Hinton (uno de los padres del deep learning, que dejó Google para poder hablar libremente sobre estos riesgos) han advertido que una AGI o superinteligencia mal alineada podría representar un riesgo existencial para la humanidad.

No son conspiranoicos. Son de las mentes más brillantes en el campo advirtiendo sobre los riesgos de lo que ellos mismos están construyendo.

Por qué debería importarte (aunque no seas técnico)

Si trabajas en cualquier sector que implique tomar decisiones, gestionar información, crear contenido, o liderar equipos, la IA actual ya te afecta. La AGI simplemente aceleraría ese impacto de forma radical.

Pero aquí va el matiz que mucha gente no ve: no necesitas esperar a la AGI para transformar tu negocio. La IA estrecha que tenemos hoy es más que suficiente para:

- Automatizar procesos repetitivos que consumen horas de trabajo humano

- Analizar datos a una escala imposible para cualquier equipo humano

- Generar contenido, código y estrategias como punto de partida

- Optimizar la toma de decisiones con datos en tiempo real

- Escalar operaciones sin escalar proporcionalmente el equipo

En mi día a día como Director de Innovación en Cleardent, he visto cómo la IA actual —bien implementada, con criterio y estrategia— puede multiplicar la capacidad operativa de un equipo. Sin necesidad de AGI. Sin esperar al futuro. Con lo que ya está disponible hoy.

La verdadera ventaja no está en predecir cuándo llegará la AGI. Está en dominar las herramientas que ya tienes en las manos mientras tu competencia sigue esperando a que "la IA sea perfecta".

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para dentistas

- Marketing para fisioterapeutas

- Marketing para nutricionistas

- Marketing para psicólogos

- Marketing para podólogos

- Marketing para ópticas

- Marketing para farmacias

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para fisioterapeutas

- Marketing para nutricionistas

- Marketing para psicólogos

- Marketing para podólogos

- Marketing para ópticas

- Marketing para farmacias

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para dentistas

- Marketing para nutricionistas

- Marketing para psicólogos

- Marketing para podólogos

- Marketing para ópticas

- Marketing para farmacias

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para dentistas

- Marketing para fisioterapeutas

- Marketing para psicólogos

- Marketing para podólogos

- Marketing para ópticas

- Marketing para farmacias

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para dentistas

- Marketing para fisioterapeutas

- Marketing para nutricionistas

- Marketing para podólogos

- Marketing para ópticas

- Marketing para farmacias

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para dentistas

- Marketing para fisioterapeutas

- Marketing para nutricionistas

- Marketing para psicólogos

- Marketing para ópticas

- Marketing para farmacias

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para dentistas

- Marketing para fisioterapeutas

- Marketing para nutricionistas

- Marketing para psicólogos

- Marketing para podólogos

- Marketing para farmacias

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para dentistas

- Marketing para fisioterapeutas

- Marketing para nutricionistas

- Marketing para psicólogos

- Marketing para podólogos

- Marketing para ópticas

- Marketing para veterinarios

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para clínicas

- Marketing para dentistas

- Marketing para fisioterapeutas

- Marketing para nutricionistas

- Marketing para psicólogos

- Marketing para podólogos

- Marketing para ópticas

- Marketing para farmacias

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para cerrajeros

- Marketing para pintores

- Marketing para jardineros

- Marketing para empresas de limpieza

- Marketing para mudanzas

- Marketing para mecánicos

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para fontaneros

- Marketing para pintores

- Marketing para jardineros

- Marketing para empresas de limpieza

- Marketing para mudanzas

- Marketing para mecánicos

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para fontaneros

- Marketing para cerrajeros

- Marketing para jardineros

- Marketing para empresas de limpieza

- Marketing para mudanzas

- Marketing para mecánicos

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para fontaneros

- Marketing para cerrajeros

- Marketing para pintores

- Marketing para empresas de limpieza

- Marketing para mudanzas

- Marketing para mecánicos

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para fontaneros

- Marketing para cerrajeros

- Marketing para pintores

- Marketing para jardineros

- Marketing para mudanzas

- Marketing para mecánicos

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para fontaneros

- Marketing para cerrajeros

- Marketing para pintores

- Marketing para jardineros

- Marketing para empresas de limpieza

- Marketing para mecánicos

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

- Marketing para fontaneros

- Marketing para cerrajeros

- Marketing para pintores

- Marketing para jardineros

- Marketing para empresas de limpieza

- Marketing para mudanzas

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

Marketing digital para profesiones similares

Si te ha resultado útil esta guía, estas otras de marketing para profesiones del mismo sector también te pueden interesar:

Inteligencia Artificial aplicada a negocio

Sin humo. Solo experimentos reales, prompts que funcionan y estrategias de escalabilidad.